10月30日,百川智能发布Baichuan2-192K大模型。其上下文窗口长度高达192K,能够处理约35万个汉字,是Claude2(支持100K上下文窗口,实测约8万字)的 4.4倍,更是 GPT-4(支持32K上下文窗口,实测约 2.5万字)的14倍。

上下文窗口长度是大模型的核心技术之一,通过更大的上下文窗口,模型能够结合更多上下文内容获得更丰富的语义信息,更好的捕捉上下文的相关性、消除歧义,进而更加准确、流畅的生成内容,提升模型能力。

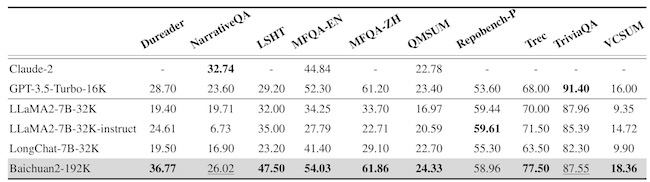

Baichuan2-192K在Dureader、NarrativeQA、LSHT、TriviaQA等10项中英文长文本问答、摘要的评测集上表现优异,有7项取得SOTA。

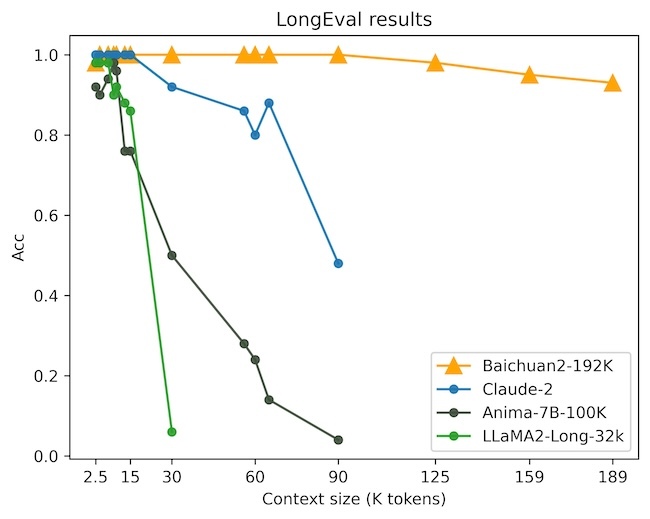

此外,LongEval的评测结果显示,在窗口长度超过100K后Baichuan2-192K依然能够保持强劲的性能,而其他开源或者商用模型在窗口增长后效果都出现了近乎直线下降的情况。Claude2也不例外,在窗口长度超过80K后整体效果下降非常严重。

(LongEval是加州大学伯克利分校联合其他高校发布的针对长窗口模型的评测榜单,主要用来衡量模型对长窗口内容的记忆和理解能力)

扩大上下文窗口能有效提升大模型性能是人工智能行业的共识,但是超长上下文窗口意味着更高的算力需求和更大的显存压力。

目前,业内有很多提升上下文窗口长度的方式,包括滑动窗口、降采样、小模型等。这些方式虽然能提升上下文窗口长度,但对模型性能均有不同程度的损害,换言之都是通过牺牲模型其他方面的性能来换取更长的上下文窗口。

而本次百川发布的Baichuan2-192K通过算法和工程的极致优化,实现了窗口长度和模型性能之间的平衡,做到了窗口长度和模型性能的同步提升。

今年9月25日,百川智能已开放了Baichuan2的API接口,正式进军企业级市场,开启商业化进程。此次Baichuan2-192K将以API调用和私有化部署的方式提供给企业用户,目前百川智能已经启动Baichuan2-192K的API内测,开放给法律、媒体、金融等行业的核心合作伙伴,不久后还将全面开放。

(责任编辑:谭梦桐)